はじめに

音声合成技術の精度は年々高まっています。この技術は、ナビゲーションシステムから仮想アシスタント、エンターテイメント業界まで、幅広い用途で利用されています。しかし、この技術の急速な発展は、新たなリスクも生み出しています。中でも、「ディープフェイク音声」と呼ばれる技術の悪用は、個人のプライバシーやセキュリティに深刻な脅威をもたらしています。

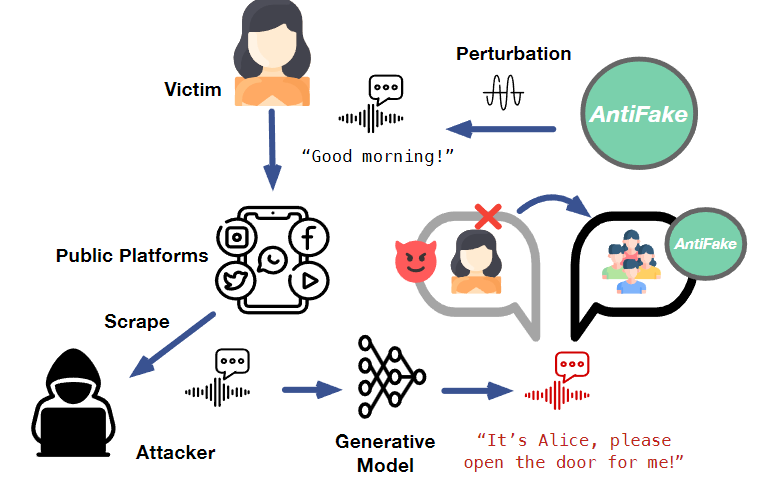

そこで、この記事では、米セントルイス・ワシントン大学の研究者たちが開発した革新的な防御ツール「AntiFake」にスポットを当てます。

このツールは、個人の声を悪用から守るために設計されており、ディープフェイク技術による音声の不正使用を防ぐことを目的としています。

この記事を通して、AntiFakeのメカニズム、その効果、そして私たちの日常生活に与える影響について掘り下げていきます。

研究者らが発表した論文はこちら

https://dl.acm.org/doi/10.1145/3576915.3623209

デモはこちら

https://sites.google.com/view/yu2023antifake

音声合成技術の現状とリスク

音声合成技術の進化

音声合成技術は近年、進化しています。この技術は、人間の声を模倣し、リアルタイムで自然な音声を生成する能力を持っています。

映画やゲームのキャラクターの声、AIアシスタントの応答、教育ツールでの使用など、その適用範囲は日々広がっています。

ディープフェイク音声の悪用

しかし、この技術がもたらすリスクも無視できません。

特に、「ディープフェイク音声」として知られる技術の悪用が問題になっています。

実際の人間の声をほぼ完璧に模倣することが可能で、この技術を悪用すると、詐欺、誤情報の拡散、個人の名誉を傷つける行為などが容易に行えてしまいます。

例えば、CEOの声を模倣して従業員に偽の命令を出す、有名人の声を使って虚偽の声明を発表するなどの事件が報告されています。

法的な課題

このようなディープフェイク音声の悪用に対して、現行の法律は対応が追いついていません。

音声の権利やプライバシーに関する明確な法的枠組みがないため、被害者が権利を主張しにくい状況があります。また、技術の進歩に伴い、法律が適切に更新されるまでのタイムラグが大きな問題となっています。

このように現状はまだ多くの課題がある状態になっています。

AntiFakeの開発背景

研究の動機

音声合成技術の悪用が増加する中、個人の声の安全を確保する方法の開発が急務となっています。

この技術による悪用は、単なるプライバシーの侵害にとどまらず、社会全体への信頼性の低下やセキュリティ上のリスクをもたらしています。

こうした背景から、米セントルイス・ワシントン大学の研究者たちは、声を保護するための新しいアプローチを模索し始めました。

AntiFakeの目的

研究チームが目指したのは、音声合成技術による悪用を未然に防ぐことです。

従来のディープフェイク音声検出ツールとは異なり、AntiFakeは音声が合成されるプロセス自体を妨げることで、悪用を根本から断つことを目指しています。

これにより、個人が公開する音声データの安全性を高め、社会全体の信頼を保つことができます。

技術革新への対応

AntiFakeの開発は、技術革新に対する重要な対応策です。音声合成技術の進化に伴い、ディープフェイク音声の検出が困難になっている現状に対して、研究チームは防御の方向性を変える必要があると判断しました。このツールは、声を合成する前の段階で介入し、不正な利用を根絶することを可能にします。

AntiFakeの仕組み

引用元:https://sites.google.com/view/yu2023antifake/

敵対的摂動とは

AntiFakeの核となるのは、「敵対的摂動」という技術です。

これは、音声信号に微細なノイズを加えることで、人間の耳には通常通り聞こえるが、AIによる音声合成システムでは誤認識される音声を生成するというものです。

このノイズは、AIが音声データから特定の特徴を抽出するプロセスを妨害し、結果としてAIによる正確な音声合成を阻害します。

人間とAIの認識の違い

人間の耳は驚くほど適応力があり、微細なノイズが加わった音声でも、内容を正確に理解することができます。しかし、AIの音声合成システムはこのようなノイズに非常に敏感で、わずかな変化によっても認識精度が大きく低下します。

AntiFakeはこの特性を利用して、AIが原音声と異なる音声を生成するように仕向けています。

実用化に向けて

この技術は、特にSNSやWebサイトなどで公開される音声データの保護に役立ちます。

ユーザーは、自分の声を録音する前にAntiFakeを通して処理を行うことで、その音声が不正に利用されるリスクを軽減できます。また、AntiFakeは音声データのセキュリティを高めることで、ディープフェイクによる詐欺や誤情報の拡散を防ぐ重要なツールとなり得ます。

AntiFakeの評価と実効性

包括的な評価方法

AntiFakeの有効性を確かめるため、研究チームは複数の音声合成システムと話者認証システムでの評価を行いました。

評価対象には、商業製品であるElevenLabsを含む最先端の5つの音声合成器と、3つの話者認証システムが含まれています。

これにより、AntiFakeが実際のアプリケーションにおいてどれだけ効果的であるかを検証しました。

高い保護率の実証

評価の結果、AntiFakeは95%以上の保護率を達成しています。

これは、AntiFakeを使用した音声が、音声合成システムによって不正確に認識され、元の話者とは異なる音声が生成されることを意味します。

この高い保護率は、AntiFakeが現実世界での悪用に対して強力な防御策となり得ることを示唆しています。

実用性の評価

さらに、研究チームは悪意のある目的で分類された実際のディープフェイク文を使用して評価を行いました。また、AntiFakeがブラックボックスの商業モデルにも適用可能であることが示され、その汎用性と効果の幅広さが実証されました。

まとめ

いかがだったでしょうか?

この記事では、私たちは音声合成技術の進歩とそれに伴うリスク、そしてそれに対抗するために開発された画期的な防御ツール「AntiFake」について深く掘り下げてきました。

AntiFakeの開発は、個人のプライバシーを保護し、社会全体の信頼性と安全性を高めるための重要な一歩と言えます。

このような技術の発展と普及は、今後ますます期待されており、技術革新に伴う法的・倫理的な課題への対応も、引き続き重要な議題となるでしょう。

ARCHETYP Staffingではクリエイターを募集しています!

私たちはお客様の課題を解決するweb制作会社です。現在webサイト制作以外にも、動画編集者やIOSエンジニアなど幅広い職種を募集していますのでぜひチェックしてみてください!

以下のボタンから募集中の求人一覧ページに移動できます。