中国発のAIモデルDeepSeekが注目を集めてから1ヶ月。今度はドイツの研究チームが、そのモデルを2倍の速度で動かすことに成功しました。TNG Technology Consulting GmbHが開発したR1T2 Chimeraは、同じ賢さを保ちながら高速化を実現。どのような技術でこの成果を達成したのでしょうか。

ARCHETYP Staffingでは現在クリエイターを募集しています。

エンジニア、デザイナー、ディレクター以外に、生成AI人材など幅広い職種を募集していますのでぜひチェックしてみてください!

ボタンから募集中の求人一覧ページに移動できます。

ドイツの研究チームが実現した「2倍速」の仕組み

この驚きの成果を生み出したのは、TNG Technology Consulting GmbHというドイツの技術コンサルティング会社です。2001年に設立された同社は、バイエルン州を拠点に900人以上の従業員を抱え、博士号取得者や技術専門家を多数擁しています。電気通信、保険、自動車、eコマース、物流といった幅広い分野で、大手企業にソフトウェア開発とAI技術のコンサルティングを提供してきた実績があります。

では、同社が発表したR1T2 Chimeraの「2倍速」とは何を意味するのでしょうか。一般的な処理速度の向上とは異なり、TNGが測定した「速度」とは、AIが回答を生成する際の文章量の違いを指します。

従来のDeepSeek R1-0528は、思考連鎖推論により長く詳細な回答を出力する傾向がありました。しかしR1T2 Chimeraは同じ質問に対して、必要な部分だけを簡潔にまとめて回答します。具体的には、元のモデルが必要としていた出力トークン数(AIが生成する文章の長さを測る単位)の約40%で済むようになりました。驚くべきは、この短縮が回答の質を犠牲にしていない点です。AIME-24、AIME-25、GPQA-Diamondという数学と科学の能力を測るベンチマークにおいて、R1T2は元のR1-0528の90%から92%の性能を維持しています。

この文章量の削減は実用面で大きな意味を持ちます。クラウドサービスでAIを利用する場合、生成される文字数に応じて料金が発生するため、直接的なコスト削減につながるのです。また短い回答は読み手の時間節約にもなり、特に高スループットの環境では大きなメリットとなります。

では、この画期的な効率化はどのような技術によって実現されたのでしょうか。

3つのAIを組み合わせる新技術の中身

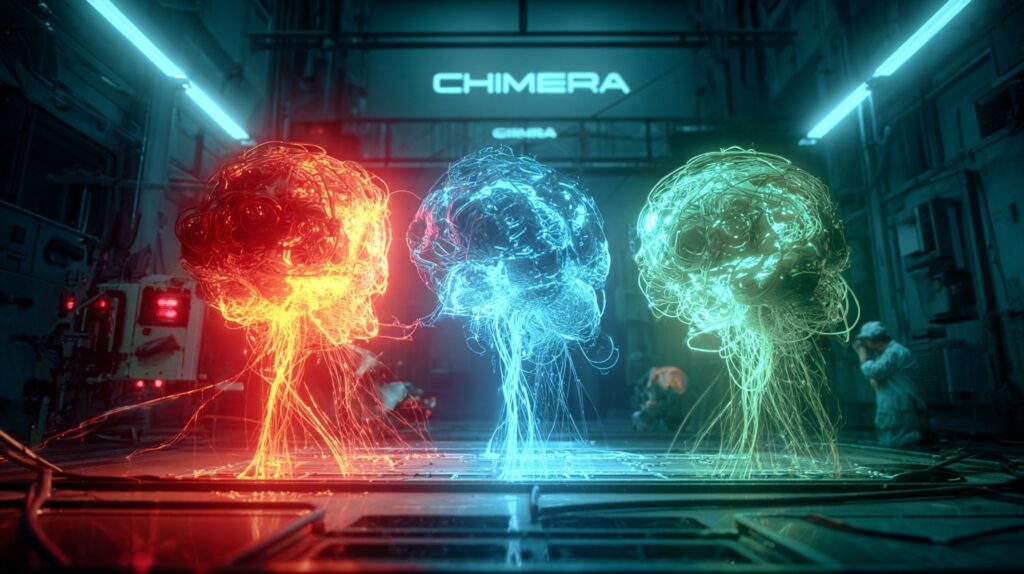

R1T2 Chimeraの効率化を可能にしたのは、Assembly-of-Experts(AoE)という技術です。これは複数の既存AIモデルの重みテンソル(AIが学習で獲得した知識を数値化したもの)を選択的に統合してモデルを構築する手法で、まさに技術の新境地と言えるでしょう。

TNGが採用したのは「Tri-Mind」と呼ばれる構成で、3つの異なるDeepSeekモデルを統合しています。DeepSeek-R1-0528からは高度な推論能力を、DeepSeek-R1からは構造化された思考パターンを、DeepSeek-V3-0324からは簡潔で指示指向の動作を受け継いでいます。それぞれが持つ最良の特性を一つのモデルに集約したのです。ここで重要なのは、よく混同されるMixture-of-Experts(MoE)との違いを理解することです。MoEは一つのAIの内部で、入力に応じて異なる専門コンポーネントを条件的に活性化するアーキテクチャです。任意のトークンの順伝播中に、モデルの専門家レイヤーのサブセットのみが活性化される仕組みとなっています。

一方、AoEはモデル統合技術であり、アーキテクチャではありません。複数の事前訓練済みMoEモデルから、それぞれの重みテンソルを選択的に補間することで新しいモデルを作成します。TNGの実装では、特に専門的な推論を担当する「ルーティング専門家テンソル」の統合に重点を置きながら、より高速なモデルからの効率的な共有層と注意層を保持しています。

この手法の真に画期的な点は、追加の微調整や再訓練が不要だったことです。既存の3つのモデルが持つ知識と能力を、新たな訓練なしに組み合わせることで、それぞれの長所を活かした新しいモデルを作り上げました。TNGが5月にarXivで発表した論文では、この手法について詳細な技術的解説が提供されており、実際の利用においてもその効果が実証されています。

この技術的な躍進が、実際の利用においてどのような価値をもたらすのか、次に詳しく見ていきましょう。

実際に使う時のメリットと注意点

R1T2 Chimeraを実際に利用する場合の最大のメリットは、運用コストの劇的な削減です。出力トークン数が60%削減されることで、クラウドサービスでAIを利用する際の料金を大幅に下げることができます。さらに、GPU(グラフィック処理装置)の使用時間とエネルギー消費も削減され、特に高スループットや実時間環境では計り知れない価値を持ちます。

このモデルはMIT Licenseで公開されており、誰でも自由に使用、修正、商用利用が可能です。企業は自社のプライベート環境でモデルをホスティングしたり、特定の用途に合わせてカスタマイズしたりできます。規制環境やエアギャップ環境での利用にも制限がないため、幅広い用途での活用が期待できます。ただし、現時点では注意すべき制限もあります。TNGは、関数呼び出し(AIが他のソフトウェアやツールと連携する機能)やツール使用を必要とする用途には推奨していないと明記しています。これはDeepSeek-R1系統から継承した制限で、将来のアップデートで対処される可能性があるとしています。

グローバル展開を考える場合、2025年8月2日に発効するEU AI法への対応が重要になります。欧州でサービスを提供する企業は関連条項の検討が必要ですが、米国国内で事業を行い米国ユーザーにサービスを提供する企業は、この規制の対象外となります。

TNGは既にOpenRouterやChutesなどのプラットフォームで以前のChimeraモデルを提供しており、日々数十億のトークンが処理されているという確かな運用実績があります。R1T2は現在Hugging Faceで公開されており、Hugging FaceのVaibhav Srivastav氏からは「R1-0528より200%高速で、R1より20%高速」という高い評価を受けています。

このような技術の積み重ねが、AIの実用性をさらに高め、より多くの人々にとって身近な存在にしていく基盤となっているのです。

まとめ

いかがだったでしょうか?

TNG Technology Consulting GmbHが開発したDeepSeek-TNG R1T2 Chimeraは、既存のAIモデルを巧みに組み合わせることで、同等の性能を保ちながら大幅なコスト削減を実現しました。Assembly-of-Expertsという手法により、新たな訓練なしに3つのモデルの長所を統合し、出力を60%削減しながら90%以上の性能を維持しています。MIT Licenseでの公開により、企業や個人が自由に活用できる点も大きな魅力です。ただし、関数呼び出しやツール使用には制限があるため、用途を見極めた上での導入検討が重要になります。

ARCHETYP Staffingではクリエイターを募集しています!

私たちはお客様の課題を解決するweb制作会社です。現在webサイト制作以外にも、動画編集者や生成AI人材など幅広い職種を募集していますのでぜひチェックしてみてください!

また、アーキタイプではスタッフ1人1人が「AI脳を持ったクリエイター集団」としてこれからもクライアントへのサービス向上を図り、事業会社の生成AI利活用の支援及び、業界全体の生成AIリテラシー向上に貢献していきます。

生成AIの活用方法がわからない、セミナーを開催してほしい、業務を効率化させたいなどご相談ベースからお気軽にお問い合わせください!

ボタンから募集中の求人一覧ページに移動できます。